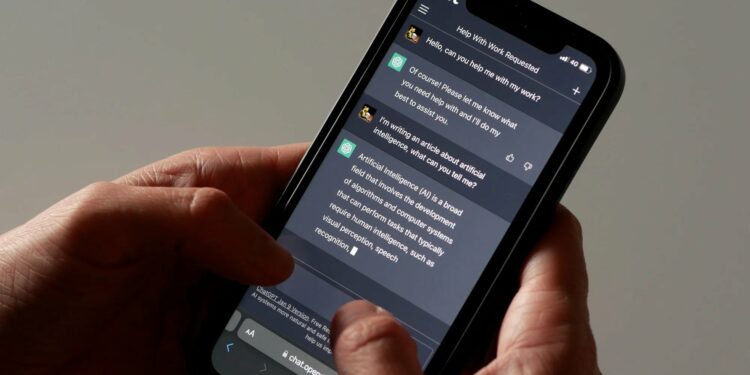

Është e vështirë të besohet, por ChatGPT është vetëm një vjeç. Kur OpenAI lançoi për herë të parë ChatGPT në nëntor 2022, ai u bë aplikacioni me rritjen më të shpejtë të të gjitha kohërave, shkaktoi panik brenda Google dhe ndezi fitilin për një garë gjeneruese të AI brenda Big Tech.

Që atëherë, rritja e inteligjencës artificiale gjeneruese që është quajtur revolucioni i ardhshëm industrial, ngriti pyetje filozofike dhe etike rreth mbijetesës njerëzore dhe bëri që qeveritë t’i kushtojnë vëmendje potencialit të saj shkatërrues. Pra, po, ishte një vit mjaft i madh për AI.

Askund nuk është më e dukshme kjo se sa në internet. Natyrisht, AI mbështetet në internet. Pavarësisht nëse përmendet në mënyrë eksplicite apo jo, AI la gjurmën e saj në të gjithë internetin këtë vit.

Inteligjenca artificiale gjeneruese në vitin 2023 ka qenë një udhëtim i egër që na ka plakur shumë më shumë se një vit. Jemi të sigurt që nga këtu e tutje do të jetë krejtësisht e ftohtë, por së pari, le të hedhim një vështrim prapa.

- I dha “halucinacioneve” një kuptim të ri

Ky ishte viti kur të gjithë mësuan se kompjuterët mund të kenë halucinacione, por jo në një mënyrë argëtuese apo transcendentale. Halucinacioni është kur AI gjenerues i fabrikon me besim përgjigjet e tij, duke i dhënë iluzionin e besimit të diçkaje që nuk është e vërtetë.

LLM-të punojnë duke parashikuar në mënyrë probabiliste fjalën tjetër bazuar në sasinë masive të të dhënave mbi të cilat është trajnuar. Për shkak të kësaj, halucinacionet e AI shpesh kanë kuptim nga ana gjuhësore dhe ndonjëherë përmbajnë elemente të realitetit, gjë që e bën të vështirë ndarjen e fakteve nga marrëzitë absolute. Kjo, ose fillon të tingëllojë si shoku yt duke kërcyer topat në Burning Man.

Që kur u publikua ChatGPT, i ndjekur nga Bing Chat dhe Bard, interneti ka qenë i mbushur me gjëra të çmendura që kanë thënë chatbot-et e AI. Ato varionin nga të padëmshme dhe megjithëse rrëqethëse deri te shpifëse dhe të dëmshme. Edhe Google ra pre e chatbot-it të tij Bard duke përfshirë informacione të pasakta në një video demo. Pavarësisht, kjo ka pasur efektin kumulativ për ta bërë internetin realitet të hamendjes së dytë.

- Shtyu “deepfakes” drejt rrymës

Deepfakes, ose mediat që janë ndryshuar nga AI për t’u dukur reale, kanë qenë një shqetësim për disa kohë. Por këtë vit, disponueshmëria e gjerë e mjeteve gjeneruese të AI e bëri më të lehtë se kurrë krijimin e imazheve, videove dhe audiove realiste.

OpenAI DALL-E 3, Google Bard dhe gjeneratori i imazheve SGE, Microsoft Copilot (dikur Bing Chat Image Creator) dhe Meta’s Imagine janë të gjithë shembuj të modeleve që përdorin AI gjeneruese për të krijuar imazhe nga kërkesat e tekstit. Edhe platformat mediatike Shutterstock, Adobe dhe Getty Images janë futur në lojë me mjetet e tyre të gjenerimit të imazheve të AI.

Shumë prej këtyre shërbimeve kanë parmakë mbrojtëse dhe kufizime për të luftuar detyrimet dhe dëmet e botës reale që paraqet gjenerimi i imazheve të AI. Shenjat e imazheve si krijime të inteligjencës artificiale, refuzimi i gjenerimit të fytyrave fotorealiste ose paraqitjeve të figurave publike dhe ndalimi i përmbajtjeve të rrezikshme ose të papërshtatshme janë disa nga mënyrat se si ato po parandalojnë përdorimin e poshtër.

- Ngritja e alarmit për të dhënat e trajnimit

Si u bënë kaq të rëndësishme LLM-të? Ata janë të trajnuara në tërësinë e internetit. Gjithçka – postimet në Reddit, postimet në mediat sociale, faqet e Wikipedia-s, qindra mijëra libra pirate, faqe lajmesh, punime akademike, titra në YouTube, bloge ushqimore, meme – ushqejnë orekset e pangopura të modeleve të AI. OpenAI dhe Google u goditën të dy me padi grupore nga firma ligjore Clarkson Law Firm për gjoja “vjedhje” të informacionit personal pa pëlqimin dhe shkeljen e veprave me të drejtë autori. Meta dhe Microsoft po përballen gjithashtu me padi për trajnimin e modeleve të tyre në bazën e të dhënave Books3 që përfshinte libra pirate. (Baza e të dhënave Books3 u hoq në gusht pas një ankese DMCA.) - Na prezantoi me përmbajtjen e krijuar nga AI

Një nga aftësitë e mahnitshme të AI gjeneruese është shkrimi i gjuhës me tingull natyral. Aktualisht, shumica e përmbajtjeve të krijuara nga AI lexojnë si ajo e një nxënësi të shkollës së mesme që nuk e ka bërë të gjithë leximin – i prirur për pasaktësi dhe pak robotik. Por me kalimin e kohës, LLM-të po përmirësohen, duke e bërë automatizimin e artikujve, njoftimeve për shtyp, listat e vendeve të punës, veprat krijuese dhe të tjera tepër joshëse për t’u kaluar për shumë njerëz. Por, përpjekjet e hershme për të prezantuar përmbajtjen e gjeneruar nga AI tek konsumatorët kanë hasur në reagime të konsiderueshme. - Premtoi se do të ndryshojë marrëdhëniet tona me punën

Premtimi për rritjen e produktivitetit të punës ka qenë një pikë kryesore e shitjes për kompanitë e teknologjisë që lançuan mjetet e AI këtë vit. Microsoft, Google, Zoom, Slack, Grammarly dhe të tjerë kanë mbrojtur të gjithë aftësinë e AI gjeneruese për të shkurtuar detyrat në një pjesë të kohës. Me këto mjete ende në fillimet e tyre, dhe shumë prej tyre në faza pilot ose të disponueshme vetëm për klientët që paguajnë, efektet në shkallë të gjerë nuk janë parë ende.

Ajo që ne dimë është se mjetet gjeneruese të inteligjencës artificiale për punë nuk janë të besueshme – të paktën jo pa mbikëqyrjen njerëzore, gjë që hedh një lloj çelësi në të gjithë premtimin e produktivitetit. Ju duhet patjetër të kontrolloni dy herë përgjigjet e tyre dhe duhet të jeni të kujdesshëm për atë që ndani me LLM si ChatGPT. Samsung e zbuloi rrugën e vështirë kur punonjësit e saj pa dashje ndanë informacione pronësore me ChatGPT, pa e ditur se inputet e tyre ishin përdorur potencialisht për të trajnuar modelin.

Së fundmi, OpenAI lançoi një veçori që i lejoi përdoruesit të heqin dorë nga ndarja e të dhënave të tyre me ChatGPT dhe prezantoi versione miqësore për ndërmarrjet për t’i mbajtur marrëdhëniet e biznesit të sigurta dhe të sigurta – përveç nëse ka një shkelje të të dhënave natyrisht./mashable